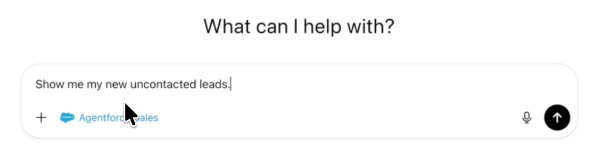

Verkkopalveluyritys Cinia järjesti tänään neljännen kerran Cyber Security Focus -tapahtuman, jossa asiantuntijat pohtivat kyberturvallisuuden tulevaisuutta. Trend Microlla kyberuhkien vanhempana tutkijana työskentelevä David Sancho kertoi esimerkein, kuinka vaaralliseksi aseeksi tekoäly muuttuu verkkorikollisten käsissä. Tämä näkyy esimerkiksi deepfake-videoissa.

Verkkopalveluyritys Cinia järjesti tänään neljännen kerran Cyber Security Focus -tapahtuman, jossa asiantuntijat pohtivat kyberturvallisuuden tulevaisuutta. Trend Microlla kyberuhkien vanhempana tutkijana työskentelevä David Sancho kertoi esimerkein, kuinka vaaralliseksi aseeksi tekoäly muuttuu verkkorikollisten käsissä. Tämä näkyy esimerkiksi deepfake-videoissa.

Tekoälyä voi käyttää sekä hyvään että pahaan. Periaatteessa tekoälyssä on kyse kilpajuoksusta kyberrikollisten ja tietoturvayritysten välillä. – Peli ei kuitenkaan ole menetetty. Tekoälyn voi voittaa paremmalla tekoälyllä, Sancho lohdutti.

Tällä hetkellä verkkorikolliset käyttävät tekoälyä ennen kaikkea pysyäkseen piilossa. On jo olemassa haittaohjelmia, joka käyttävät AI-algoritmeja tunnistaakseen onko kone murtautumisen arvoinen. Tekoäly ymmärtää, missä ympäristössä kone on.

Toinen toiminta, jossa tekoälyä hyödynnetään, on salasanojen arvaaminen. Tätä Sancho pitää huolestuttavana ilmiönä. – Tekoälyn avulla voidaan arvata koko salasanatietokanta järjestelmällisesti. AI etsii salasanoista toistuvia kuvioita (patterns) ja tekee niiden perusteella edistyneitä arvauksia. Tämä on paljon tehokkaampaa kuin perinteinen salasanojen arvaaminen, Sancho sanoo viitaten ns. brute force -menetelmiin.

Esimerkiksi CAPTCHA-kuvat ovat erilaisille skripteille erittäin vaikeita tunnistaa, mutta tekoälyn avulla voi yrittää tunnistaa kuvioita. Tähän astihan CAPTCHAa on murrettu manuaalisesti työpajoissa Intiassa, Sancho sanoi.

Some-kanavissa ja -sovelluksissa käynnissä on trendi, jossa haitallinen tekoäly yrittää matkia ihmisen toimintaa. Sanchon mukaan on esimerkiksi luotu ohjelma, joka liikuttaa hiirtä spotifyssa metallibiisistä toiseen. – Tällainen käytös muistuttaa ihmisen käytöstä, eikä Spotify koskaan sulje tällaista tiliä.

Tulevaisuudessa iso uhka muodostuu tekoälyä hyödyntävästä social engineeringistä eli käyttäjän manipuloinnista. Tekoälyn avulla voidaan esimerkiksi luoda suuria määriä tekstejä, jotka näyttävät älykkäiltä. Tämä voidaan Sanchon mukaan käyttää esimerkiksi sähköpostihuijauksissa, mutta myös sisällöntuotannossa. - Uutisten tuottaminen suuressa mittakaavassa voi vakuuttaa ihmiset siitä, että joku uutinen on totta.

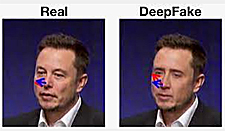

Tekstin lisäksi tekoäly pystyy luomaan väärennettyä kuvaa. Jopa videoita, kuten kohutut deepfake-videot osoittavat. – Tekoälyn avulla osataan jo muokata kasvojen ilmeitä, mikä on jo vaativampaa kuin pelkkä kasvojen vaihtaminen. Vaativinta olisi koko kuvan luominen nollasta, ja tällainenkin tekniikka on jo olemassa.

Sancho kertoi esimerkin aasialaispoliitikon deepfake-videosta, jossa poliitikko ”paljasti” homoseksuaalisen suhteensa. - Tämä osoittaa, miten vaarallisesta työkalusta väärissä käsissä tekoälyssä on kyse. Rikollisilla on käytössään kaikki työkalut, mitä meilläkin. Lopulta kyse on tekoälyjen välisestä taistelusta, Sancho kuvaa.

Sanchon esitys perustui Trend Micron yhdessä YK:n ja Europolin kanssa laatimaan selvitykseen siitä, miten rikolliset voivat hyödyntää tekoälyä. Dokumentin voi ladata Trend Micron sivuilta.