AI kiihdyttää ohjelmistokehitystä nopeammin kuin sitä ehditään enää testata. Ongelma ei kuitenkaan ole siinä, että kehittäjät liikkuisivat liian nopeasti. Ongelma on paljon perustavampi. Yksi osa ohjelmistokehityksestä on kiihtynyt dramaattisesti, mutta kaikki sitä valvovat rakenteet ovat jääneet lähes paikoilleen, kirjoittaa amerikkalaisen BotGauge AI:n perustaja ja toimitusjohtaja Pramin Pradeep.

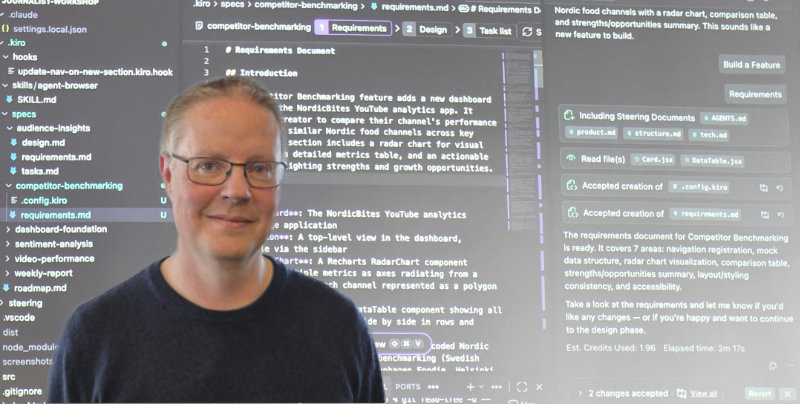

AI-avustajat muuttavat täysin sen, mitä yksi kehittäjä pystyy tekemään tunnissa. Funktio, jonka kirjoittamiseen, testaamiseen ja dokumentointiin kului aiemmin puoli päivää, syntyy nyt puolessa minuutissa. CI/CD-putket puskevat koodia tuotantoon kymmeniä kertoja päivässä. Monessa organisaatiossa matka ideasta tuotantoon mitataan jo tunneissa, ei viikoissa.

Mutta testausinfra ei ole rakennettu tähän maailmaan.

Nykyiset QA-prosessit syntyivät aikaan, jolloin ihmiset kirjoittivat jokaisen rivin itse, julkaisut etenivät sprinttisyklissä ja testaus tapahtui projektin lopussa. Tätä rytmiä ei enää ole. Samalla kuilu AI:n tuottaman koodin ja sen todellisen validoinnin välillä kasvaa kuukausi kuukaudelta.

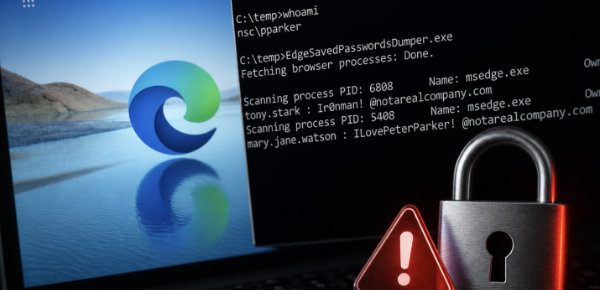

Keskustelu AI-koodista keskittyy yleensä väärään asiaan. Puhutaan siitä, onko koodi syntaktisesti oikein tai sisältääkö se tunnettuja haavoittuvuuksia. Staattiset analyysityökalut, linterit ja tietoturvaskannerit ovat tässä jo varsin hyviä.

Todellinen riski ei kuitenkaan ole syntaksissa vaan käyttäytymisessä.

AI:n generoima koodi voi näyttää täydelliseltä. Se voi läpäistä kaikki automaattiset tarkistukset ja silti sisältää oletuksia, jotka muuttuvat vaarallisiksi vasta myöhemmin tuotannossa. Tietokantafunktio voi esimerkiksi olettaa datamäärän pysyvän pienenä. Kehitysympäristössä kaikki toimii täydellisesti. Puolentoista vuoden päästä sama logiikka alkaa kuitenkin hajota kuorman kasvaessa.

Tai API-käsittelijä ohittaa validoinnin, johon muu järjestelmä luottaa. Ongelma näkyy vasta tietyssä käyttäjäsyötteiden yhdistelmässä. Näitä virheitä ei löydä yksikään skanneri.

Kyse ei ole enää perinteisistä bugeista, vaan oletuksista, jotka AI leipoo logiikkaan ymmärtämättä järjestelmän laajempaa arkkitehtuuria. Kun organisaatio tuottaa satoja AI-generoituja koodinpätkiä viikossa, tällaiset oletukset alkavat kasautua.

Samalla syntyy ilmiö, jota osa kehittäjistä kutsuu nimellä shadow code. Kehittäjä ymmärtää kyllä hyväksymänsä snippetin tarkoituksen. Hän tietää, mitä ongelmaa se ratkaisee. Mutta hän ei välttämättä enää ymmärrä, miten se käyttäytyy koko järjestelmän tasolla, mitä oletuksia se tekee muiden palveluiden datarakenteista tai mitä tapahtuu edge casessa, jota promptissa ei koskaan määritelty.

Yksittäin nämä aukot ovat pieniä. Satojen integraatioiden ja iterointien jälkeen niistä syntyy järjestelmä, joka toimii, mutta jota kukaan ei enää ymmärrä kokonaisuutena. Tämä on AI-aikakauden todellinen riski.

Perinteinen koodikatselmointi ei ratkaise ongelmaa. AI:n generoima koodi näyttää usein siistiltä, loogiselta ja täysin uskottavalta. Review-vaiheessa tarkastetaan yleensä se, toimiiko funktio. Harvemmin enää pysähdytään miettimään, mitä oletuksia koodi tekee järjestelmästä kolme kerrosta syvemmällä.

Lisäksi volyymi karkaa käsistä. Kun koodia syntyy koneen nopeudella, ihmisten tekemä review muuttuu väistämättä pullonkaulaksi. Aikapaineessa tarkastus typistyy nopeasti kahteen kysymykseen: näyttääkö tämä hyvältä ja menevätkö testit läpi?

Syvempi analyysi jää tekemättä.

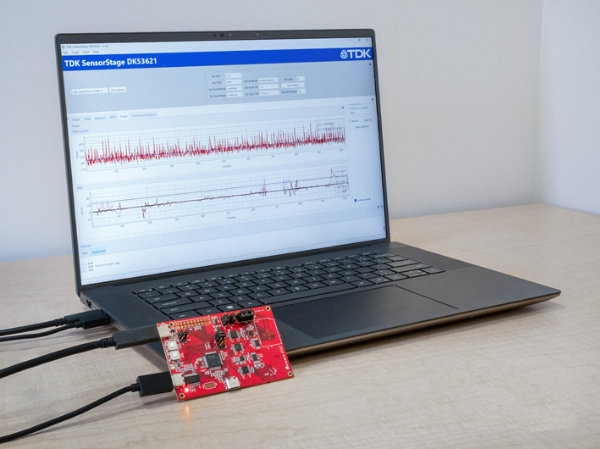

Siksi myös testauksen painopisteen on muututtava. Enää ei riitä, että testataan yksittäisiä koodiartefakteja. Nyt pitäisi validoida koko järjestelmän käyttäytymistä.

Se tarkoittaa runtime-käyttäytymisen jatkuvaa analysointia realistisissa kuormitustilanteissa. Edge casejen etsimistä, joita kukaan ei osannut ennakoida. Palveluiden välisten interaktioiden tutkimista tilanteissa, joissa koko järjestelmä on samanaikaisesti kuormitettu. Tätä ei voi enää tehdä sprintin lopussa.

Kun koodia julkaistaan kymmeniä kertoja päivässä, kahden viikon QA-portti ei enää ole todellinen kontrolli. Testauksen pitää muuttua jatkuvaksi, autonomiseksi ja tuotantoympäristöä jatkuvasti simuloivaksi prosessiksi.

Tässä kohtaa myös agenttinen AI muuttaa koko pelin. AI ei enää vain ehdota koodia. Se kirjoittaa, testaa, refaktoroi ja deployaa sitä itsenäisesti. Samalla ohjelmistokehityksen vanha perusajatus alkaa murentua. Siis se, että joku todella ymmärtää koko järjestelmän.

Ehkä tulevaisuuden vaarallisin koodi ei olekaan huonosti kirjoitettua koodia. Vaan koodia, jota kukaan ei enää kokonaan lue.

Kirjoittaja Pramin Pradeep johtaa yhdysvaltalaista BotGauge AI:tä, joka kehittää autonomista QA-as-a-Service -ratkaisua modernien ohjelmistotiimien tarpeisiin. Yrityksen tavoitteena on automatisoida ohjelmistojen laadunvarmistus AI-aikakauden kehitysnopeuteen sopivaksi.