Nvidia takoo tällä hetkellä tuhottomasti rahaa tekoälyyn sopivilla GPU-prosessoreillaan. GTC 2024 -tapahtumassa yhtiön pääjohtaja Jensen Huang esitteli prosessorin, joka toimii mittarina kaikille muille. Ainakin seuraavan vuoden ajan.

Huangin mukaan tekoäly siirtyy nyt multimodaaliseen vaiheeseen. Malleja ei enää kouluteta internetin teksteillä vaan kaikenlaisella datalla: graafeilla, videolla ja audiolla. Nämä jopa biljoonan parametrin mallit tarvitsevat yhä enemmän suorituskykyä.

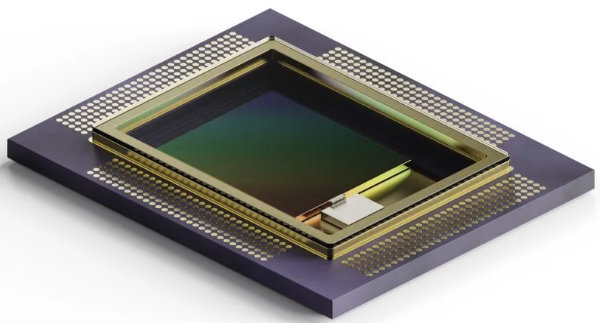

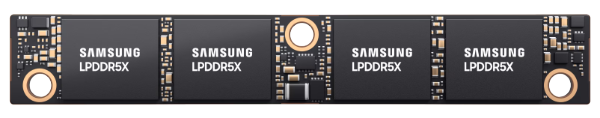

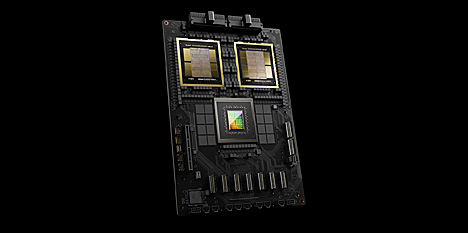

Onneksi Nvidialla on esittää uusi prosessoriarkkitehtuuri, joka suoriutuu tästä kaikesta. Kyse on Blackwell-arkkitehtuurista, joka lanseerattiin kahdella eri piirillä. B200 on uusi grafiikkaprosessori ja GB200-sirua Huang nimitti vaatimattomasti superprosessoriksi.

Nvidian mukaan uusi B200 GPU tarjoaa jopa 20 petaflopsia FP4-laskentatehoa. Sirulla on 208 miljardia transistoria. GB200-piirille yhdistetään kaksi näistä GPU-prosessoreista yhdeksi Grace-suorittimeksi, joka tarjoaa aiempaan verrattuna 30 kertaa paremman suorituskyvyn LLM-mallien päättelyyn. Samalla energiankulutus pienenee murto-osaan, joka 25 kertaa aiempaa pienemmäksi.

Huangin mukaan 1,8 biljoonan parametrimallin kouluttaminen olisi vaatinut aiemmin 8000 Hopper-grafiikkaprosessoria ja 15 megawattia tehoa. Jatkossa sama onnistuu 2000 Blackwell-prosessorilla, jotka kuluttavat vain neljä megawattia.

Blackwell-prosessoreille Nvidia on kehittänyt toisen sukupolven muunninarkkitehtuurin, joka kaksinkertaistaa laskennan, kaistanleveyden ja mallin koon käyttämällä neljää bittiä kutakin neuronia kohti aiemman kahdeksan sijaan. Toinen hyppäys suorituskyvyssä tapahtuu, kun näitä prosessoreita liitetään toisiinsa uuden sukupolven NVLink-kytkimellä. Liitäntään voi istuttaa 576 prosessoria, jotka kommunikoivat keskenään 1,8 teratavun putken läpi.

Tämä vaatii paljon liitäntäpiiriltä, jossa siinäkin on 50 miljardia transistoria.

Jensen Huangin Keynote-puheen voi katsella Youtubessa.