Ihmisille helppo operaatio eli epäsäännööisen muotoisiin esineisiin tarttuminen on erittäin hankala tehtävä roboteille. Berkeley Labin robottirakentajat ovat kehittäneet niin näppäräsormisen robotin, että se osaa poimia ja siirtää reaalimaailman kohteita 99 prosentin onnistumisprosentilla.

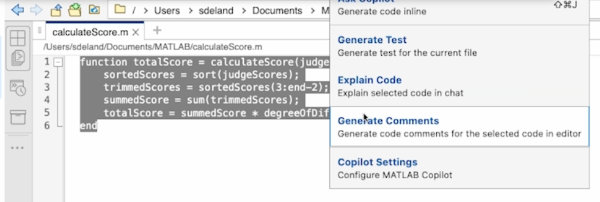

DexNet 2.0:ksi nimetty robotti saavutti tarkan kätevyytensä syväoppimisella. Tutkijat kokosivat laajan tietokannan kolmiulotteisia muotoja – yhteensä 6,7 miljoonaa datapistettä – jota neuroverkko käytti oppiessaan poimimaan ja siirtää epäsäännöllisen muotoisia esineitä.

Neuroverkko on yhdistetty 3D-anturointiin ja robotin käsivarteen. Kun objekti on sijoitettu DexNet 2.0:n eteen se nopeasti tutkii muodon ja valitsee tarttumiskohdan, josta onnistuneesti poimia ja liikuttaa kohdetta 99 prosenttia ajasta.

Kahdeksan vuotta sitten MIT:ssä julkistettiin anturitekniikka, jossa käytetään fyysistä kosketusta saada aikaan yksityiskohtainen 3D-kartta kohteen pinnasta. Nyt näitä GelSight-antureita käyttäen kaksi MIT:n tutkijaryhmää on antanut roboteille suuremman herkkyyden ja kätevyyden. GelSight-anturi on tutkijoiden mukaan tietyllä tapaa vaatimattoman teknologian ratkaisu vaikeaan ongelmaan.

GelSight-anturi selvittää geelipalan yhden maalatun pinnan kosketuksen sekä vastapuolen värivalojen ja kameran avulla kohteen 3D-muotoja.

Ensimmäisessä työssä robotti tunnistaa koskettamiensa pintojen kovuutta vähän samaan tapaan kuin ihminenkin eli sormenpäässä tapahtuvan muutoksen perusteella.

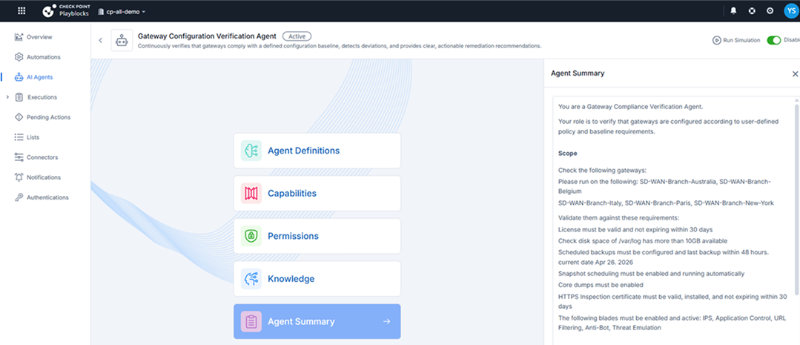

Toinen ryhmä keskittyi konenäköön, jota autonominen robotti tyypillisesti käyttää manipuloidakseen esineitä ympäristössään. Konenäkö tarjoaa robotille tarkkaa tietoa objektin sijainnista mutta kohteeseen tarttuminen on paljon vaikeampaa.

Yleensä tällaisen lähestymistavan haaste on sovittaa yhteen visiojärjestelmän tuottama data tuntoanturin tuottamaan dataan. Koska GelSight itsessään on kamerapohjainen, sen data on paljon helpompi integroida visuaaliseen dataan kuin muiden tuntoantureiden dataan.

Veijo Hänninen

Nanobittejä 7.6.2017