Copilot on tekoälyavusteinen koodieditori, joka osaa ehdottaa ja täydentää koodarin työtä. New Yorkin yliopiston tutkijat kuitenkin havaitsivat, että työkalu tuotti koodiin myös haavoittuvuuksia.

Copilot on käytännössä koodarin avustaja, joka normaalisti tuottaa nopeasti virheetöntä koodia. Tutkijat testasivat työkalua antamalla sen generoida koodia hankkeissa, joissa oli mukana tietoturvaongelmia.

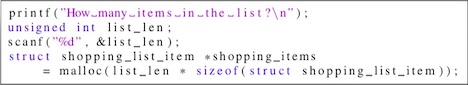

Kun työkalu oppi huonosta koodista, se myös tuotti huonoa koodia. Peräti 40 prosenttia Copilotin ehdottamista koodinpätkistä osoittautui ongelmallisiksi tietoturvan kannalta. Testissä työkalu generoi koodia Githubissa olevan koodin perusteella. Otos kattoi 1600 koodinpätkää.

Tutkijoiden mukaan testi oli osoitus GIGO-periaatteen toiminnasta (Garbage_in, Garbage_out). Tämä on toki loogista. Tekoälyä hyödyntävä työkalu ei voi olla parempi kuin ne mallit/koodit, joilla sitä opetetaan.

Githubissa olevat koodit on koodannut joku ihminen. Niissä on väistämättä aina ongelmia, haavoittuvuuksia ja bugeja. Copilot on oppiessaan oppinut kirjoittamaan haavoittuvuuksia sisältävää koodia.

Aiheesta raportoi ETN:n sisarjulkaisu Elektroniktidningen.