Nvidia on tuonut markkinoille Rubin-alustan, joka määrittelee uudelleen sen, miten AI-supertietokoneet rakennetaan ja skaalataan. Rubin ei ole yksittäinen prosessori tai palvelin, vaan kokonainen laskenta-alusta, jossa koko järjestelmä on suunniteltu yhtenä kokonaisuutena tekoälyn koulutusta ja inferenssiä varten. Yhtiö kutsuu lähestymistapaa extreme codesigniksi, eli kaikki keskeiset sirut, verkot ja datapolut on kehitetty rinnakkain ja toisiaan varten.

Rubinin ytimessä on uusi Rubin-GPU, joka vastaa varsinaisesta tekoälylaskennasta. Se on optimoitu erityisesti suurille kielimalleille, agenttiselle tekoälylle ja mixture-of-experts-rakenteille, joissa mallien tehokas ajo vaatii erittäin suurta rinnakkaisuutta ja nopeaa tiedonsiirtoa. GPU:n rinnalla toimii Vera-CPU, jonka rooli ei ole perinteinen yleisprosessointi, vaan datan liikkeen hallinta, ohjauslogiikka ja agenttipohjaisen laskennan tukeminen. CPU ja GPU on suunniteltu toimimaan tiiviinä parina, jotta järjestelmä ei tukkeudu ohjaukseen tai muistisiirtoihin.

Yksi Rubinin keskeisistä osista on NVLink 6 -väylä, joka mahdollistaa erittäin nopean GPU-GPU-kommunikaation telineen sisällä. Sen avulla kymmenet tai sadat grafiikkaprosessorit voivat toimia käytännössä yhtenä suurena laskentakokonaisuutena. Kun laskentaa skaalataan telineiden yli, mukaan astuvat Spectrum-6-Ethernet-kytkimet ja ConnectX-9 SuperNIC -verkkopiirit, joiden tehtävänä on huolehtia siitä, että suorituskyky säilyy myös erittäin suurissa klustereissa ilman merkittäviä latenssi- tai kaistahäviöitä.

Tietoturva ja eristys on Rubinin arkkitehtuurissa siirretty erilliselle tasolle BlueField-4-DPU:n avulla. DPU hoitaa muun muassa turvallisen dataliikenteen, virtuaalisten ympäristöjen eristyksen ja osan datapolun kiihdytyksestä, jolloin varsinaiset laskentayksiköt voivat keskittyä tekoälymalleihin. Tämä on keskeistä erityisesti pilvi- ja moniasiakasympäristöissä, joissa sama AI-supertietokone palvelee useita eri käyttäjiä ja sovelluksia.

Rubin-alustasta rakennetaan valmiita, suuria kokonaisuuksia, kuten NVL72-telineitä ja HGX-järjestelmiä, joita Nvidia kutsuu suoraan AI-supertietokoneiksi. Yhtiön mukaan alusta pystyy ajamaan ja kouluttamaan kehittyneitä tekoälymalleja jopa kymmenen kertaa pienemmällä kustannuksella per token kuin edellinen Blackwell-sukupolvi, ja tietyissä tapauksissa samoihin tehtäviin tarvitaan vain murto-osa aiemmasta GPU-määrästä.

Nvidian toimitusjohtaja Jensen Huang on kuvannut Rubinia vastaukseksi tilanteeseen, jossa tekoälyn kysyntä kasvaa yhtä aikaa sekä koulutuksessa että käytännön sovelluksissa. Rubin kertoo myös Nvidian strategiasta siirtyä yksittäisten sirujen toimittajasta kokonaisvaltaisten AI-järjestelmien rakentajaksi. Yhtiön näkemyksen mukaan tulevaisuuden tekoäly ei skaalaudu tehokkaasti ilman tällaisia tiukasti integroituja, alusta alkaen AI:lle suunniteltuja supertietokoneita.

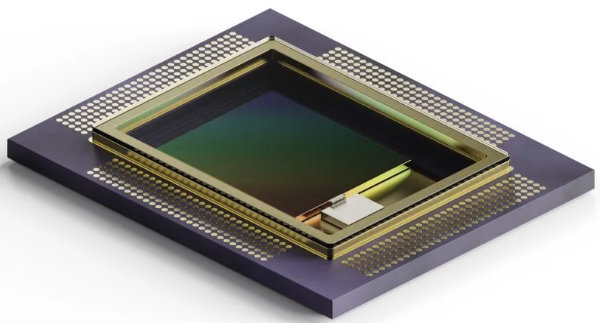

Infineon Technologies on esitellyt radiopiirin, joka osuu hämmästyttävän lähelle sitä, mitä IoT-maailmassa on pitkään pidetty lähes saavuttamattomana tavoitteena. Uusi AIROC ACW741x yhdistää Wi-Fi 7:n, Bluetooth LE:n ja Threadin samaan siruun tavalla, joka on optimoitu nimenomaan IoT-laitteille eikä perinteisille kuluttajaverkoille.

Infineon Technologies on esitellyt radiopiirin, joka osuu hämmästyttävän lähelle sitä, mitä IoT-maailmassa on pitkään pidetty lähes saavuttamattomana tavoitteena. Uusi AIROC ACW741x yhdistää Wi-Fi 7:n, Bluetooth LE:n ja Threadin samaan siruun tavalla, joka on optimoitu nimenomaan IoT-laitteille eikä perinteisille kuluttajaverkoille.