Kun autonomisista autoista tulee todellisuutta ja eri puolilla maailmaa testataan robottiautoja, yhä useampi alkaa kysyä etiikkaan ja vastuuseen liittyviä kysymyksiä. Suunnittelijat ovat kuitenkin painineet eettisten ongelmien kanssa jo vuosia osana tekniikan kehitystä.

Täysin automaattisen auton haaste vastuumielessä nousee heti kun tapahtuu onnettomuus. Ennen kuin tämä kysymys ratkaistaan, ajoneuvoja ei voida vakuuttaa eikä niitä siten tulla näkemään julkisilla teillä. Tämä eroaa nykyisestä puoliautomaattisista toiminnoista kuten Teslan beetavaiheen Autopilot-ohjelmistosta, joka edelleen vaatii ihmiskuljettajaa olemaan ohjaimissa.

Mikäli onnettomuus aiheutuu kuljettajasta, vastuukysymys on helppo. Mutta voiko kuskiton auto olla syyllinen, mikäli ne noudattaa tarkoin määriteltyjä liikennesääntöjä? Jos robottiauto on syyllinen, tarkoittaako se että ohjelmointi on viallinen? Onko tässä tapauksessa onnettomuudesta vastuussa ajoneuvon omistaja, autonvalmistaja vai alijärjestelmien toimittaja? Volvo sivuutti tämän ongelman nätisti aiemmin tänä vuonna ilmoittamalla ensimmäisenä autonvalmistajana ottavansa täyden vastuun ajoneuvoistaan, jotka kulkevat ilman kuljettajaa.

Mutta ehkäpä ajoneuvo noudatti ohjelmointinsa hätätilanneprotokollaa, ja päätyi sen takia mahdollisesti kuolemantapauksiinkin johtavaan törmäykseen? Tämä on eettisen ongelman ydin. Keskeisesti kyse on haasteesta määritellä, kenet tappaa äärimmäisessä tilanteessa. Yleensä esimerkkinä tarjotaan tietä, jonka toisella kaistalla on äiti lapsineen ja toisella puolella joukko koululaisia, sekä jyrkkä vuori ja jyrkänne tien molemmin puolin. Törmääkö robottiauto äitiin, koululaisiin, vuorenseinään vai ajaako se alas jyrkännettä, jolloin matkustaja kuolisi?

Hiljattain Mercedes selvensi omaa ajatteluaan tällaisessa ongelmassa. Sen mukaan vastuulla on suojella matkustajaa ajoneuvossa, ei jalankulkijoita. Tämä johti raflaaviin otsikoihin ”tappajaroboteista”.

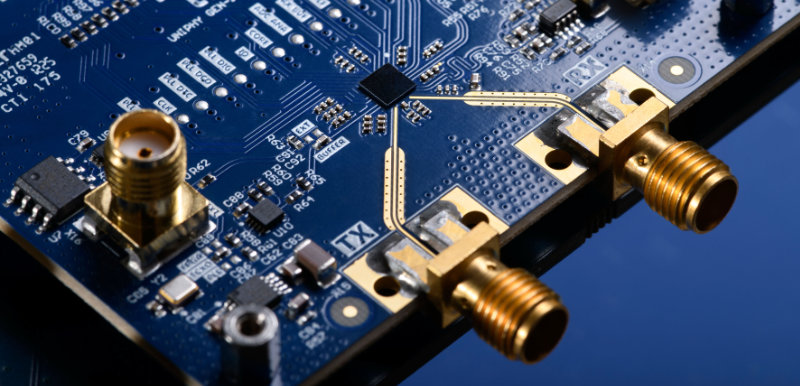

Itse asiassa ongelman kuvaaminen itsessään on ongelma. Tilanteessa missä ei ole tilaa liikkua robottiauto liikkuu hitaasti ja laajentaa LiDAR-, laser- ja ultraääniantureidensa kantamaa havaitakseen mahdollisia törmäysriskejä. Anturitoimittajat toimittavat kuitenkin myös ohjelmiston, joten ovatko he osin vastuussa onnettomuustilanteessa?

Yksi tärkeä muistettava asia on se, että robottiauto pystyy myös pysähtymään paljon nopeammin kuin ihmiskuljettaja. Mahdollisen törmäyksen havaitessa robottiauto voi aloittaa pysäytysprosessin muutamassa millisekunnissa, mikä käynnistää suojausmekanismit matkustajille joko kiristämällä turvavöitä tai laukaisemalla turvatyynyt täydessä hätäpysäytyksessä. Anturien kantama on paljon pysähtymismatkaa pidempi, joten ajoneuvo saadaan pysähtymään ennen kuin kukaan jalankulkija on vaarassa.

LiDAR-anturit rakentavat ajoneuvon ympäristöstä 3D-mallin ja kehitettäävt ohjelmistoalgoritmit säädetään havaitsemaan juuri tämänkaltaisia riskeä. Itse asiassa iso haaste on elimoinoida ns. väärät positiiviset lukemat, mutta suunnittelijat tekevät virheitä turvallisuuden suhteen. Tämän takia käytetään useita anturijärjestelmiä, joiden avulla data voidaan varmistaa millisekunneissa.

Uusimmilla antureilla, nopealla ohjelmiston päätöksenteolla ja sisäisellä matkustajien suojauksella sekä jalankulkijoihin että matkustajiin kohdistuva riski saadaan minimoitua, kuten täytyykin tapahtua.

Riski ja vastuu tulevat siten ulkoisista lähteistä kuten hakkeroinnista. Jos ajoneuvo hakkeroidaan ja sen ohjelmistoa muutetaan, se ei ole enää turvallinen kenellekään. Tämän takia ajoneuvojen välisten langattomien V2V-verkkojen (vehicle to vehicle) tietoturva on äärimmäisen tärkeää ja robottiautojärjestelmien suunnittelijat työskentelevät haasteen parissa herkeämättä.

Robottiautoihin sisältyy riskejä, mutta ei siellä missä ihmiset ajattelevat niiden olevan. Suurin haaste on taistelu ammattimaisen hakkerin ja järjestelmän kehittäjän välillä, kun matkustajia, jalankulkijoita ja muita tien käyttäjiä yritetään suojella hyökkäyksiltä. Myös vastaukset vastuukysymyksiin löytyvät samasta suunnasta.

Artikkelin on kirjoittanut Mouser Electronicsin Mark Patrick.

Artikkelin on kirjoittanut Mouser Electronicsin Mark Patrick.