Amerikkalaistutkijat UCLA:n Samueli School of Engineeringissä ja Stanfordin yliopistossa ovat demonstroineet tietokonejärjestelmää, joka pystyy löytämään ja tunnistamaan todelliset esineet, joita se ”näkee” vastaavanlaisella visuaalisen oppimisen menetelmällä kuin ihmiset. Järjestelmä on edistys konenäön sektorilla sekä tärkeä askel kohti yleisiä keinotekoisia älykkäitä järjestelmiä.

Amerikkalaistutkijat UCLA:n Samueli School of Engineeringissä ja Stanfordin yliopistossa ovat demonstroineet tietokonejärjestelmää, joka pystyy löytämään ja tunnistamaan todelliset esineet, joita se ”näkee” vastaavanlaisella visuaalisen oppimisen menetelmällä kuin ihmiset. Järjestelmä on edistys konenäön sektorilla sekä tärkeä askel kohti yleisiä keinotekoisia älykkäitä järjestelmiä.

Tällaiset tietokoneet oppivat itse, ovat intuitiivisia, tekevät päätöksiä perustelujen perusteella ja ovat vuorovaikutuksessa ihmisten kanssa inhimillisemmällä tavalla.

Vaikka nykyiset konenäön järjestelmät ovat yhä tehokkaampia ne ovat tehtäväkohtaisesti rajattuja. Ne eivät ole suunniteltu omatoimiseen oppimiseen. Ne on koulutettava tarkalleen, mitä oppia, yleensä tarkastelemalla tuhansia kuvia, joissa tunnistettava kohde on niille merkitty.

Ne eivät myöskään osaa luoda kuvaa kohteesta, jos vain osa kohteesta näkyvissä. Tietokoneet eivät myöskään osaa selittää perusteluja valokuvan esineen määrittämiseksi: Tekoälypohjaiset järjestelmät eivät rakenna sisäistä kuvaa tai opittujen esineiden mallia, kuten ihmiset tekevät.

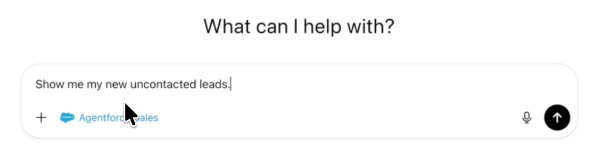

Uusi lähestymistapa koostuu kolmesta laajasta vaiheesta. Ensin järjestelmä hajottaa kuvan pieniksi paloiksi, joita tutkijat kutsuvat nimellä viewlets eli ”vilkaisuiksi". Toiseksi tietokone oppii, miten nämä vilkaisunäkymät sopivat yhteen muodostamaan kyseessä olevan kohteen. Lopuksi järjestelmä tarkastelee, mitä muita kohteita ympäröivällä alueella on ja onko kyseisten esineiden informaatio olennaista ensisijaisen kohteen kuvaamiseen ja tunnistamiseen.

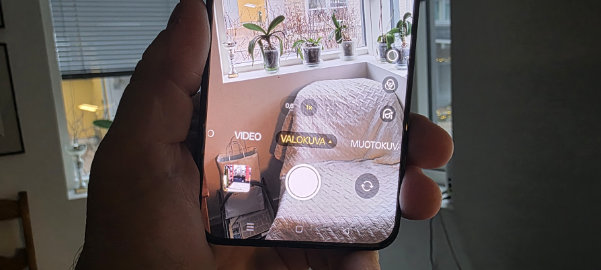

Auttaakseen uutta järjestelmää ”oppimaan” aivan kuten ihmiset, tutkijat päättivät upottaa sen ympäristöön, jossa ihmiset ”elävät” eli internetiin. Internetissä on runsaasti kuvia ja videoita, jotka kuvaavat saman tyyppisiä esineitä. Lisäksi nämä esineet näkyvät monista näkökulmista - peitettynä, lintuperspektiivissä ja erilaisiin ympäristöihin upotettuina. Kehitystyöhön tutkijat saivat myös oivalluksia kognitiivisesta psykologiasta ja neurotieteestä.

- Lapsista alkaen opimme, mitä jokin on, koska näemme monia esimerkkejä niistä monissa yhteyksissä. Tämä kontekstuaalinen oppiminen on aivojemme keskeinen piirre, ja se auttaa meitä rakentamaan vahvoja malleja objekteista, jotka ovat osa toiminnallisesti integroitua maailmankuvaa, kuvaa professori Vwani Roychowdhury UCLA:sta.

Tutkijat testasivat järjestelmää noin 9000 kuvalla, joista kukin esitti ihmisiä ja muita kohteita. Alusta pystyi rakentamaan yksityiskohtaisen mallin ihmiskehosta ilman ulkoista ohjausta ja ilman kuvien merkitsemistä.

Insinöörit tekivät testejä myös moottoripyörien, autojen ja lentokoneiden kuvilla. Kaikissa tapauksissa heidän järjestelmä suoriutui paremmin tai ainakin vastaavasti kuin perinteiset konenäköjärjestelmät, jotka on kehitetty monien vuosien koulutuksella.

Veijo Hänninen

Nanobittejä 8.1.2019